Relatório Anual de 2024 destaca o impacto do Comitê no ano das eleições

27 de Agosto de 2025

Prefácio dos copresidentes

Em 2024, considerado o maior ano eleitoral da história moderna, o Comitê de Supervisão lançou seu primeiro white paper. Com base na análise de seus estudos de caso, o documento apresentou formas pelas quais as empresas de mídia social podem lidar com os desafios relacionados à condução segura e confiável de eleições, ao mesmo tempo que protegem a liberdade de expressão, seguindo as normas internacionais de direitos humanos. Esse foco em eleições norteou a escolha dos casos analisados pelo Comitê ao longo do ano, incluindo temas como fraude eleitoral, desinformação e sátira política. Além disso, o Comitê emitiu uma decisão rápida sobre casos envolvendo a violência pós-eleitoral na Venezuela.

Outro tema abordado em 2024 foi a moderação de conteúdo na era da inteligência artificial e da automação, explorado em um segundo white paper. Esse documento aprofundou-se no funcionamento dos sistemas automatizados da Meta, destacando a importância de considerar os direitos humanos globais ao aplicar ferramentas baseadas em IA. Também ressaltou as recomendações feitas pelo Comitê em relação ao conteúdo gerado por inteligência artificial. Uma das principais recomendações feitas pelo Comitê — que solicitava à Meta a rotulagem de conteúdo criado ou modificado por inteligência artificial — foi adotada pela empresa em 2024. Outras mudanças implementadas pela Meta em resposta às nossas recomendações, emitidas como parte das decisões de casos, podem ser conferidas no Resumo Executivo abaixo.

Ao longo de cada trimestre de 2024, a Meta aceitou e colocou em prática significativamente mais recomendações do que rejeitou. Vale destacar que essa avaliação foi conduzida com base em uma metodologia independente, que exige da Meta a apresentação de evidências comprovando a efetiva implementação das recomendações.

Desde janeiro de 2021, o Comitê já emitiu mais de 300 recomendações à Meta. Dessas, 74% foram implementadas ou tiveram progresso significativo, promovendo maior transparência, regras claras e acessíveis, mais equidade para os usuários e um compromisso mais forte da empresa com suas responsabilidades em matéria de direitos humanos, incluindo a proteção da liberdade de expressão.

A equipe de dados do Comitê, responsável por desenvolver nossa metodologia de monitoramento da implementação, tem colaborado com a Meta para compreender melhor o impacto dessas ações sobre os usuários. Em 2024, o Comitê teve acesso aos dados mais detalhados até o momento para validar esse impacto, conforme apresentado na seção “Promovendo mudanças nas plataformas da Meta”, abaixo. Essas informações desempenham um papel essencial no ciclo de vida das recomendações, pois ajudam a compreender de que forma as pessoas são afetadas pelas orientações do Comitê e como podemos seguir aprimorando as plataformas da Meta em benefício dos bilhões de usuários e da proteção de sua liberdade de expressão.

Evelyn Aswad, Paolo Carozza, Michael McConnell, Pamela San Martín, Helle Thorning-Schmidt

Prefácio do presidente do Trust do Comitê de Supervisão

Como um modelo singular de supervisão da moderação de conteúdo em escala global — independente tanto de empresas quanto de governos — o Comitê segue em constante evolução para acompanhar as transformações do setor e as mudanças no cenário regulatório. Quase cinco anos após a criação do processo de apelação, é impressionante observar como essa iniciativa se consolidou como um modelo institucional de governança de conteúdo independente, baseado em princípios e com alcance global.

Em 2024, a Meta reafirmou seu compromisso com a supervisão independente ao anunciar uma nova rodada de financiamento, contribuindo com US$ 30 milhões para complementar o fundo irrevogável e garantir o funcionamento do Comitê até 2027. Paralelamente, o Comitê adotou medidas para otimizar a supervisão independente, realizando cortes orçamentários estratégicos que priorizam as áreas de maior impacto em seu trabalho.

Como parte desse esforço contínuo de aprimoramento, implementamos mudanças recentes em nossa estrutura de governança. Ao mesmo tempo que mantemos nossa independência em relação à Meta — inclusive no que diz respeito ao suporte financeiro oferecido — reformulamos nossa estrutura para incluir copresidentes na gestão da Oversight Board LLC. Essa mudança criou um espaço integrado para decisões estratégicas, orçamentárias e operacionais com o objetivo de ampliar o impacto do Comitê no longo prazo.

A promoção da responsabilização nunca foi tão essencial para fortalecer a confiança nas empresas de tecnologia. O modelo do Comitê, com sua abordagem inovadora e liderança em temas centrais de governança, mostra que isso é possível.

Stephen Neal

Sumário executivo

Desde 2021, o Comitê fez 317 recomendações à Meta, das quais 74% foram implementadas, estão em andamento ou foram relatadas pela empresa como já concluídas. Em resposta a essas recomendações, a Meta realizou as seguintes mudanças ao longo de 2024 e no início de 2025.

- Passou a identificar conteúdo criado ou modificado por inteligência artificial, oferecendo informações adicionais aos usuários sem impor restrições indevidas à liberdade de expressão.

- Padronizou suas políticas para que sejam aplicadas de forma consistente no Facebook, Instagram e Threads, aumentando a uniformidade entre as plataformas e tornando as regras mais claras para os usuários.

- Ofereceu aos usuários a possibilidade de evitar um aviso em suas contas na primeira violação de uma política elegível, mediante a realização de um exercício educativo, contribuindo para a proteção da liberdade de expressão e permitindo que os usuários compreendam por que suas publicações violaram as regras.

- Passou a permitir que os usuários adicionem contexto adicional ao recorrerem da remoção de conteúdo por discurso de ódio, evitando a aplicação indevida em casos como publicações satíricas ou outros conteúdos que poderiam se enquadrar em exceções à política, como iniciativas de aumento da conscientização.

- Melhorou os indicadores disponibilizados aos moderadores durante a análise de vídeos longos em busca de possíveis violações a fim de garantir uma aplicação mais precisa desse tipo de conteúdo.

- Realizou uma auditoria de suas listas de insultos em 22 países que realizaram eleições em 2024 como parte das ações para aprimorar a precisão na aplicação da política de Conduta de Ódio.

- Revisou sua política sobre Indivíduos e Organizações Perigosas para permitir mais liberdade de expressão em determinados contextos nos quais os usuários se referem a indivíduos classificados como “shaheed”, revogando, na prática, a proibição generalizada do uso do termo.

- Harmonizou a linguagem pública de sua política de Conteúdo Violento e Gráfico com as instruções internas destinadas aos revisores, esclarecendo aos usuários quais tipos de conteúdo são proibidos por essa política e aumentando a transparência sobre sua aplicação.

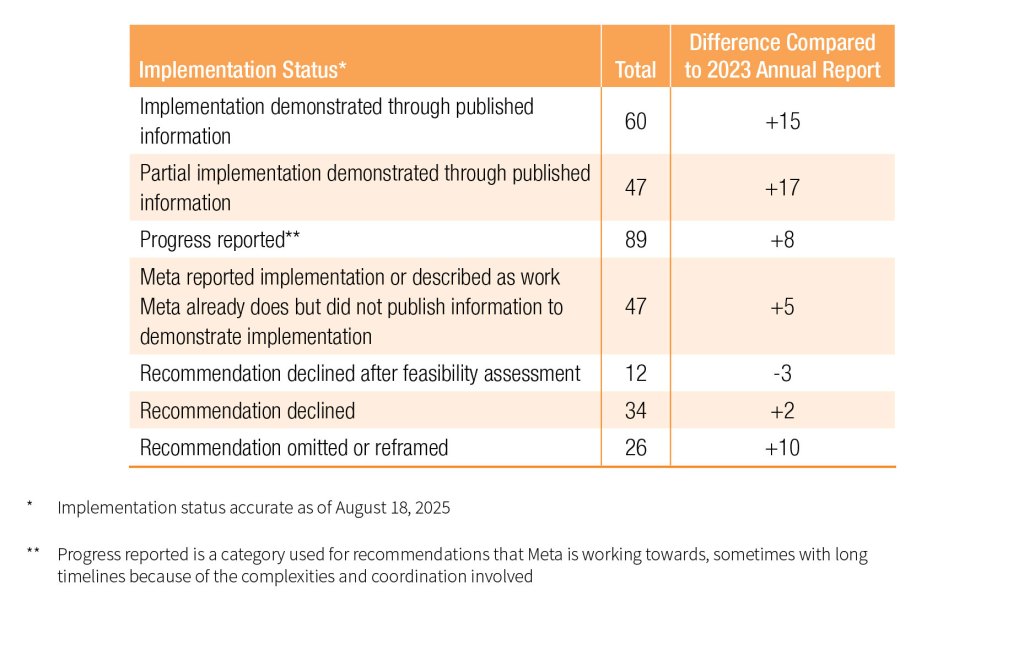

A tabela a seguir apresenta as informações mais recentes sobre o status de implementação pela Meta, evidenciando uma tendência constante de aumento na adoção total ou parcial das recomendações do Comitê, com base em dados divulgados publicamente.

O Comitê segue monitorando essa implementação por meio de sua própria metodologia independente e orientada por dados.

Promovendo mudanças nas plataformas da Meta

Além das decisões obrigatórias que emitimos sobre conteúdos específicos, o Comitê também faz recomendações às quais a Meta deve responder publicamente dentro de um prazo de até 60 dias. Essas recomendações, voltadas para o fortalecimento dos direitos humanos, maior transparência, consistência e justiça na moderação de conteúdo da Meta, estão gerando impacto para usuários e organizações em todo o mundo das seguintes formas.

- Menos restrições à liberdade de expressão

Em resposta a uma das recomendações feitas pelo Comitê no caso do Vídeo Alterado de Biden, a Meta iniciou, em maio de 2024, a rotulagem de conteúdos criados ou modificados por inteligência artificial em suas plataformas. A empresa começou a aplicar rótulos com a indicação “Informações de IA” a diversos tipos de vídeos, áudios e imagens publicados no Facebook, Instagram e Threads, oferecendo aos usuários um contexto relevante sobre a origem desses conteúdos. Nem todo conteúdo manipulado por IA representa um risco, e o uso de rótulos, em vez da remoção, representa uma alternativa que evita restrições indevidas à liberdade de expressão.

--- Durante um período de 29 dias em outubro de 2024, usuários visualizaram mais de 360 milhões de conteúdos com rótulos de IA no Facebook e 330 milhões no Instagram. Desse número, 6 milhões de cliques foram registrados em publicações rotuladas no Facebook e 13 milhões no Instagram, indicando interesse dos usuários em saber mais sobre como os conteúdos foram criados.*---

* Todas as informações são tratadas de forma agregada e anônima para garantir a privacidade do usuário. Todas as métricas são estimativas atualizadas com as melhores informações disponíveis em um momento específico.

- Prevenção de avisos e restrições de conta

Os usuários agora podem evitar que um aviso seja aplicado às suas contas ao cometer a primeira violação de uma política elegível*, desde que realizem um exercício educativo. Lançado no início de 2025, esse sistema atende a uma recomendação da primeira opinião consultiva política do Comitê sobre o Compartilhamento de Informações Residenciais Privadas. Quando ocorre a primeira violação, a Meta envia aos usuários uma “notificação de violação elegível”, que detalha a política infringida e oferece a opção de apelar da decisão ou participar do exercício educativo. Essa abordagem de prevenção de penalidades oferece aos usuários mais clareza sobre por que o conteúdo violou um Padrão da Comunidade considerado não grave, apoiando sua liberdade de expressão e evitando restrições na conta.

---Em um período de três meses a partir de janeiro de 2025, mais de 7,1 milhões de usuários do Facebook e 730 mil do Instagram visualizaram o “aviso de violação elegível”. Entre eles, quase 3 milhões optaram por realizar o exercício educativo, com a maioria (mais de 80% no Facebook e mais de 85% no Instagram) completando as etapas e evitando tanto o aviso quanto as restrições na conta resultantes.**---

** Este recurso não se aplica a violações graves dos Padrões da Comunidade, como exploração sexual, drogas de alto risco e glorificação de organizações perigosas.

- Melhorias nos tempos de resposta a parceiros confiáveis

A colaboração da Meta com os Parceiros Confiáveis — uma rede composta por ONGs, agências humanitárias e especialistas em direitos humanos de 113 países — contribui para identificar danos emergentes e casos complexos no Facebook, Instagram e Threads, que poderiam não ser detectados por outros meios. Em uma decisão relacionada à violência de gangues no Haiti, o Comitê destacou suas preocupações quanto à variação nos tempos de resposta às denúncias encaminhadas por Parceiros Confiáveis, especialmente durante períodos de crise. Em resposta à nossa recomendação relacionada:

---A Meta elevou o percentual de casos resolvidos dentro de cinco dias após fortalecer o programa, passando de 69% no segundo trimestre de 2022 para 81% no segundo trimestre de 2024. Esse avanço foi alcançado mesmo com a Meta recebendo quatro vezes mais conteúdo por meio do programa no mesmo período.---

- Apoio à liberdade de expressão

Uma opinião consultiva política emitida pelo Comitê apresentou uma análise aprofundada sobre como a forma como a Meta tratava o uso do termo árabe “shaheed” (geralmente traduzido como “mártir”) estava afetando a liberdade de expressão de milhões de usuários. Naquele momento, o uso de “shaheed” para se referir a indivíduos rotulados como perigosos pela Meta era a principal causa de remoções de conteúdo com base nos Padrões da Comunidade — mais do que qualquer outra palavra. O Comitê recomendou que a Meta atualizasse sua política sobre Indivíduos e Organizações Perigosas, permitindo o uso do termo em publicações que não contivessem incitação à violência nem elogios a indivíduos ou grupos específicos.

---Após a implementação da recomendação, a equipe de dados do Comitê, por meio da Biblioteca de Conteúdo da Meta, identificou um aumento de 19,5% no número diário de publicações com mais de 50 mil visualizações contendo a palavra “shaheed”.***---

***Esse resultado foi observado ao comparar o período anterior à implementação (março a agosto de 2024) com o período posterior (outubro de 2024 a abril de 2025), com base na análise de 31.498 publicações.

- Maior conscientização sobre abuso sexual

Em um caso de 2022 envolvendo conteúdo que mostrava a agressão sexual de uma mulher na Índia, o Comitê analisou como diferenciar publicações compartilhadas com o objetivo de conscientizar sobre o assédio sexual daquelas que visam perpetuar a violência ou a discriminação. Com base nesse caso, o Comitê recomendou que a Meta criasse uma exceção em sua política de Exploração Sexual Adulta para permitir representações de toques sexuais não consensuais sem nudez, desde que o conteúdo fosse usado em contextos de escalonamento e atendesse a critérios específicos. Conteúdos que se enquadrassem nesses critérios e tivessem como finalidade principal a conscientização sobre esse tipo de abuso passariam a ser permitidos nas plataformas da Meta, acompanhados de uma tela de aviso.

---Durante um período de três meses a partir de dezembro de 2024, mais de 15 mil conteúdos no Facebook e Instagram foram identificados como alertas de usuários sobre assédio ou abuso sexual, em conformidade com os novos critérios da política. Esse número inclui publicações que, anteriormente, teriam sido removidas, mas que agora permanecem nas plataformas da Meta com uma tela de aviso.---

Em 2024, o Comitê de Supervisão

- Publicou seus primeiros white papers, oferecendo uma liderança estratégica baseada em casos analisados, com foco em dois temas centrais da moderação de conteúdo: a proteção da integridade eleitoral e adaptação a uma nova era da inteligência artificial e da automação

- Emitiu sua primeira decisão relacionada ao conteúdo no Threads, abordando declarações sobre o Primeiro-Ministro do Japão

- Tomou decisões aceleradas sobre a crise pós-eleitoral na Venezuela

Emitiu 65 decisões

32 decisões padrão 2 decisões aceleradas 31 decisões resumidas

Sobre questões abrangentes, incluindo negação do Holocausto, imagens íntimas não consensuais, voto ilegal, casamento infantil, discurso político e violência homofóbica

Publicou 1 opinião consultiva política analisando a abordagem da Meta em relação à moderação do termo árabe “shaheed”, quando usado para se referir a organizações ou indivíduos classificados como perigosos

Emitiu 48 recomendações para a Meta

Recebeu mais de 3.250 comentários públicos

Apelações ao Comitê em 2024

Total:

558.235

Inclui 8 casos encaminhados pela Meta

Aumento:

33% em 2023

Por plataforma:

Facebook: 77% Instagram: 22% Threads: 1%

By Policy (top 5)*:

Bullying e Assédio: 22,3%

Nudez Adulta e Atividade Sexual: 17,7%

Violência e Incitação: 17,4%

Conduta de Ódio (anteriormente Discurso de Ódio): 16,2%

Bens e Serviços Restritos: 7,4%

* Com base apenas em apelos gerados por usuários para restaurar conteúdo.

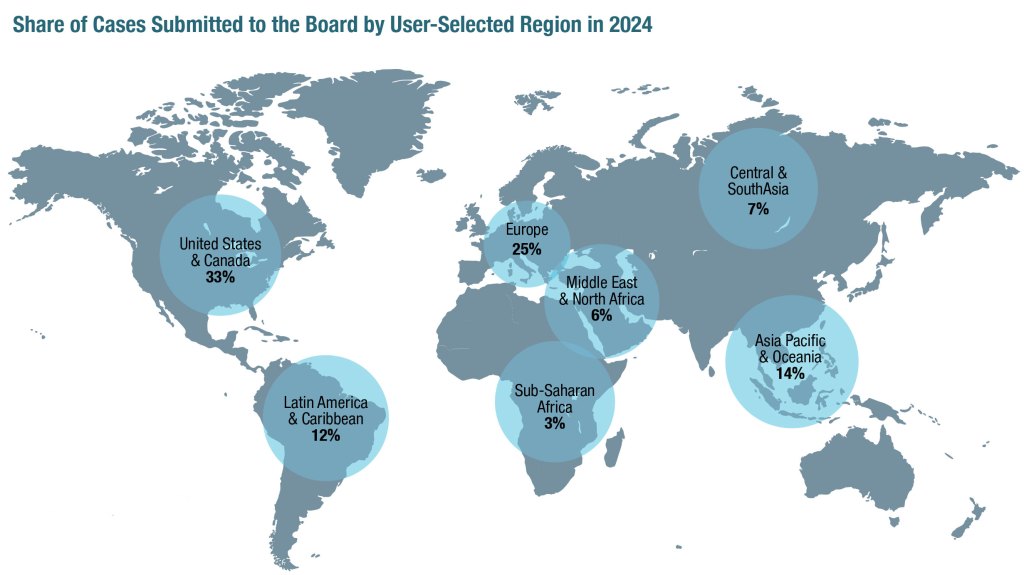

Por região

The full report is available as a PDF here.